火山引擎内容风控解决方案

立即咨询

内容安全:敏感内容流出

内容安全:敏感内容流出

UGC内容场景多、变化快、更新频繁,时刻都有产生监管风险的可能。

内容安全:敏感内容流出

内容安全:敏感内容流出

普通用户有意或无意的行为,都有可能导致敏感内容流出,从而给平台方带来较大的监管压力。

内容风控基本思路

内容风控基本思路

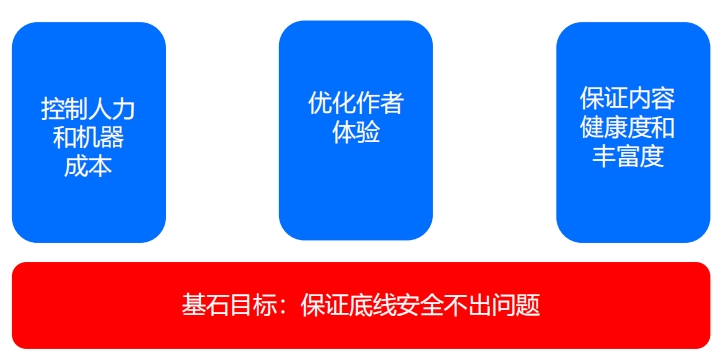

核心目标

核心目标

· 基石目标:保证底线问题事故率可控;

· 在满足基石目标的基础上,尽量减少人力和机器的成本投入;

· 与此同时,保证内容生产者的体验,不影响投稿积极性;

· 另外,同样需要保证消费者可以消费到足够有价值的内容。

核心指标 - 安全指标

核心指标 - 安全指标

① 问题内容传播率 -- 北极星指标

定义:问题内容漏放的vv/总vv,计算出视频播放量中,有多少比例是问题内容的曝光。量化平台风险指标。

优化方式:根据定级标准,对问题内容进行几个不同等级的划分。保证一定等级以上的问题内容漏放带来的vv比例低于一定程度,尽量降低该指标。

优化方式:根据定级标准,对问题内容进行几个不同等级的划分。保证一定等级以上的问题内容漏放带来的vv比例低于一定程度,尽量降低该指标。

② 举报率

定义:有效举报内容vv / 总vv,计算出视频播放量中,有多少比例是被举报内容的曝光。量化用户被影响的情况。

优化方式:通过先发召回等方案,尽量降低该指标。

优化方式:通过先发召回等方案,尽量降低该指标。

核心指标 - 成本指标

核心指标 - 成本指标

① 人力成本

i. 进审量

定义:创作者生产的内容,进到人审环节的数量。

优化方式:通过优化进审策略、优化机审模型等方式,降低进审内容数量。该指标越低,人审成本会随之降低,但并不是越少越好。

② 机器成本

ii. 人效

定义:单位时间有效人审量。

定义:单位时间有效人审量。

优化方式:通过优化人审准确率、提升平台可用性易用性等方式,不断提升审核人员的人效,该指标越高越好。

核心指标 - 作者体验指标

核心指标 - 作者体验指标

核心手段

核心手段

明确哪些是问题:

由专门的policy团队制定相关规则并负责长期维护迭代。

主要目的是:明确哪些内容存在问题,相关问题需要处理到什么程度。制定依据一般包括:

· 法律法规和监管规则

· 指令

· 社区氛围要求

· 内部用户负反馈。

尽可能早和多地发现问题

· 前置发现 - 审核策略、审核能力。

· 后置发现-举报进审、主动监控、问题回扫。

尽可能快和影响小地解决问题

· 内容-流量处置、状态处置。

· 用户-流量处置、能力处置。

核心手段 - 尽可能早和多地发现问题-前置发现

核心手段 - 尽可能早和多地发现问题-前置发现

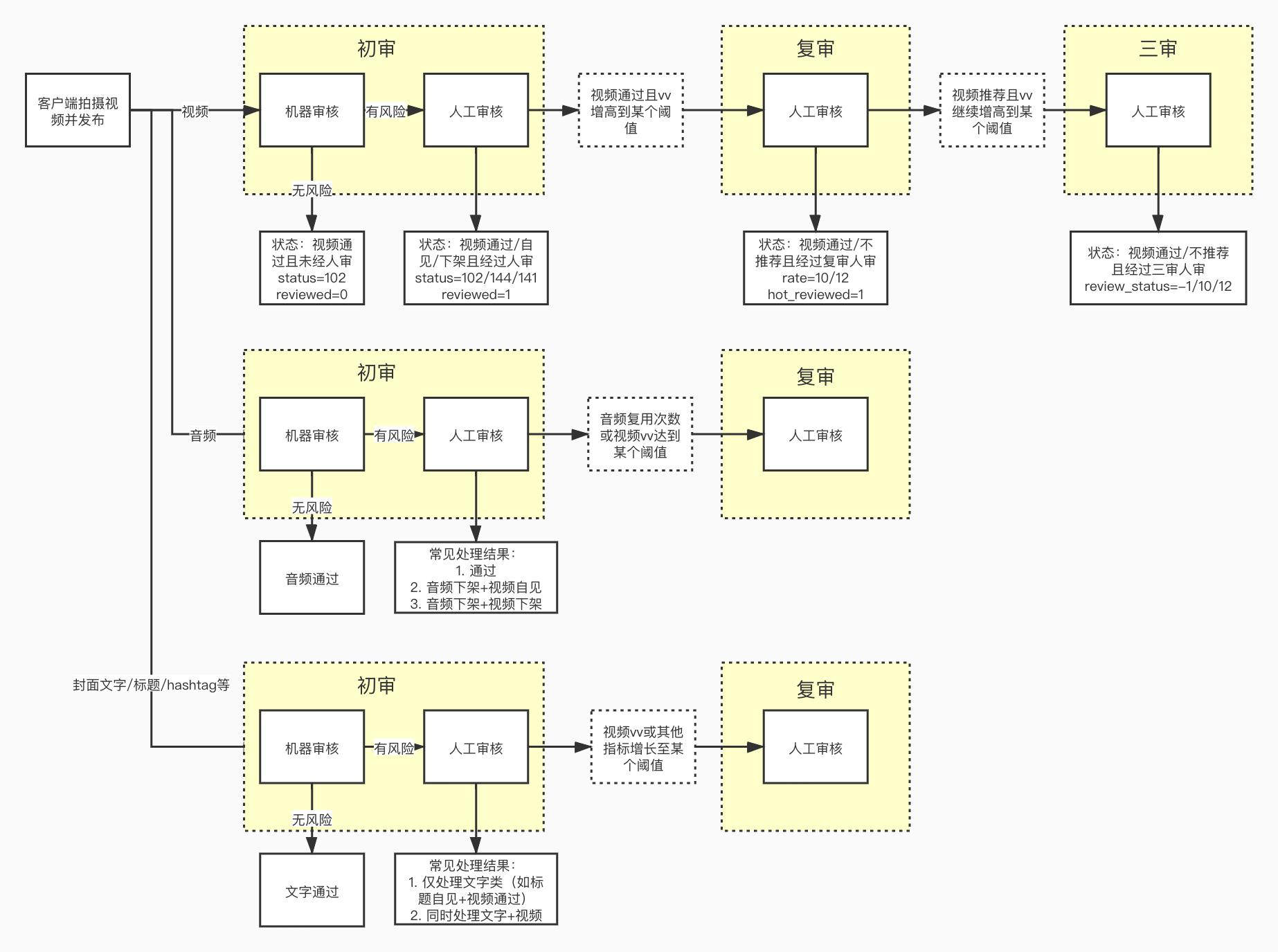

审核

每条创作者发出的内容,均会经过兜底策略(业务策略、反作弊策略等)+机审模型,判断出该内容该给到什么状态(先发、先审、自见、删除等)。

审核形式

1.初审

a.解决问题:内容安全问题,通常用来解决涉敏、涉黄、暴恐等底线问题。内容进到审核流程中的必备部分。

2.复审

a.解决问题:内容生态问题,通常用来解决标题党、低俗擦边、虚假、旧闻新发等画风问题。

核心手段 - 尽可能早和多地发现问题 - 前置发现

核心手段 - 尽可能早和多地发现问题 - 前置发现

审核框架。

核心手段 - 尽可能快和影响小地解决问题 - 内容&用户

核心手段 - 尽可能快和影响小地解决问题 - 内容&用户

内容

流量处置

· 限制流量分发(限制内容仅允许在一定的小流量池中进行分发;通常先发召回的内容会结合该方案使用)

· 特定城市不允许分发(针对城市进行分级,部分画风存在问题的内容仅在适合的分级城市被推荐)

状态处置

· 禁止投放dou+(内容禁止投流加热,一方面减少风险,另一方面防止出现资金纠纷)

· 自见(内容仅发布者自我可见,其他人不可见)

· 好友可见(内容仅发布者和存在关注关系的好友可见,其他人不可见)

· 限制流量分发(限制内容仅允许在一定的小流量池中进行分发;通常先发召回的内容会结合该方案使用)

· 特定城市不允许分发(针对城市进行分级,部分画风存在问题的内容仅在适合的分级城市被推荐)

状态处置

· 禁止投放dou+(内容禁止投流加热,一方面减少风险,另一方面防止出现资金纠纷)

· 自见(内容仅发布者自我可见,其他人不可见)

· 好友可见(内容仅发布者和存在关注关系的好友可见,其他人不可见)

· 删除(内容直接下架删除)。

用户

流量处置(参考内容的流量处置部分)

· 该用户一定时间内,全部新发内容进行相关处置;

· 该用户一定时间内,全部新发内容进行相关处置;

· 该用户历史发布内容进行相关处置

能力处置

· 该用户一定时间内,发文全部进审

· 该用户一定时间内,禁止发文

· 该用户一定时间内/用久封号

能力处置

· 该用户一定时间内,发文全部进审

· 该用户一定时间内,禁止发文

· 该用户一定时间内/用久封号

核心能力:内容风险识别

核心能力:内容风险识别

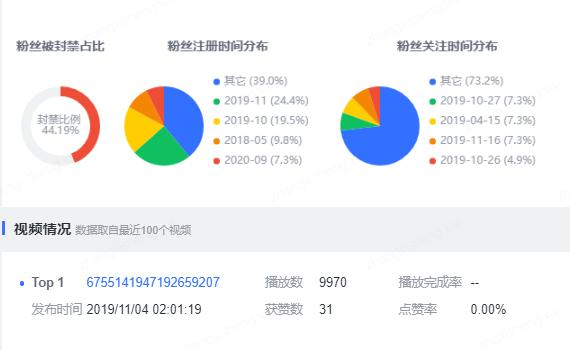

一线业务对抗数据

一线业务对抗数据

一手业务治理经验

一手业务治理经验

深耕业务治理场景,拥有未成年保护专项,抑郁症专项,防网暴专项,恶意导流专项等近10多种专项运营经验积累,成果同步在企业服务矩阵之中。

超大模型覆盖量

超大模型覆盖量

超快模型迭代速度

超快模型迭代速度

除模型的常态化迭代外,紧急运营机制可在1小时-3天内,响应突发问题,完成从数据标注到模型上线的全过程。

专业策略运营团队

专业策略运营团队

再完备的线上防控体系,在与各类风险的持续对抗中,依然离不开专业团队的支持和兜底。

主动发现

常规人工大盘巡检结合疑似违规样本机器挖掘,主动发现问题优化效果。

重保机制

针对大客户,在大盘随机巡检基础上,还提供定期的客户数据抽检和公司级专项优化。

舆情支持

获取监管单位最新要求,并结合对时事热点的挖掘能力,对模型做优化迭代。

重保机制

针对大客户,在大盘随机巡检基础上,还提供定期的客户数据抽检和公司级专项优化。

舆情支持

获取监管单位最新要求,并结合对时事热点的挖掘能力,对模型做优化迭代。

产品推荐

基于易盾安全实验室大数据算力,智能锁定唯一的设备ID,用于唯一标识设备特征。广泛应用于电商、金融、银行、游戏等行业。作为安全风控的底层核心技术的保障,离开了设备指纹,安全性就无从谈起。

百度智能云DDoS防护系统是面向用户推出的专业DDoS防护服务,基于自主研发的天网防御系统能够全面防护各种网络层和应用层的DDoS攻击,确保源站稳定可靠,业务永续无忧。您可以使用DDoS防护服务来保护您云上或云外的业务资产免受DDoS攻击的因扰。DD0S防护服务为云上客户提供5Gb的免费DDoS防护能力。当业务遭受超过5Gb的DDoS攻击时,可以以将攻击流量引向高防中心,进行清洗后再返回源站,确保源站的稳定正常运行。

腾讯云智慧传媒微短剧综合解决方案,构建“1+2+N模式”的微短剧端口,匹配多种分发场景,信息流+剧场列表双模式,满足不同观剧诉求。构建“会员+积分+等级+权益”运营体系,全快准优的全网热点发现及挖掘,行为数据分析,持续优化运营策略。

RFID智能工具管理系统:利用RFID技术,把贴有RFID标签的工具放入特殊定制并加装RFID读写器的工具车、工具柜、工具箱或工具房中,实现工具的快速借用、归还、查找、定位、盘点等功能。

首页

首页