依图科技天问多模态大模型

因为看见,所以相信:智能大爆炸时代已经到来

因为看见,所以相信:智能大爆炸时代已经到来

GPT

GPT

GPT LLM = Generative Pre-trained Transformer = 自监督学习 + 自回归模型 +下个单词的预测任务

“当时的背景是-从OpenAI早期开始,我们就一直在探索能预测你想要的下一样东西的方式。我们用当时很有限的神经网络进行了探索,希望能有一个神经网络能预测下一个单词,就能解决无监督学习的问题,这被认为是机器学习的圣杯。但是,我们的神经网络在当时无法胜任。我们当时用的是循环神经网络。当转换器(Transformer)出现时,真的就是论文刚发出来的第二天,我们立刻意识到转换器解决了循环神经网络的限制,解决了学习的长距离依赖。这是个技术决策,但我们立刻切换到了转换器(Transformer)技术。从此之后,GPT就一直使用Transformer底层技术直到今天,而且它的效果越来越好。这最终产生了GPT-3以及我们(OpenAI)今天取得的成绩。”

——ILYA

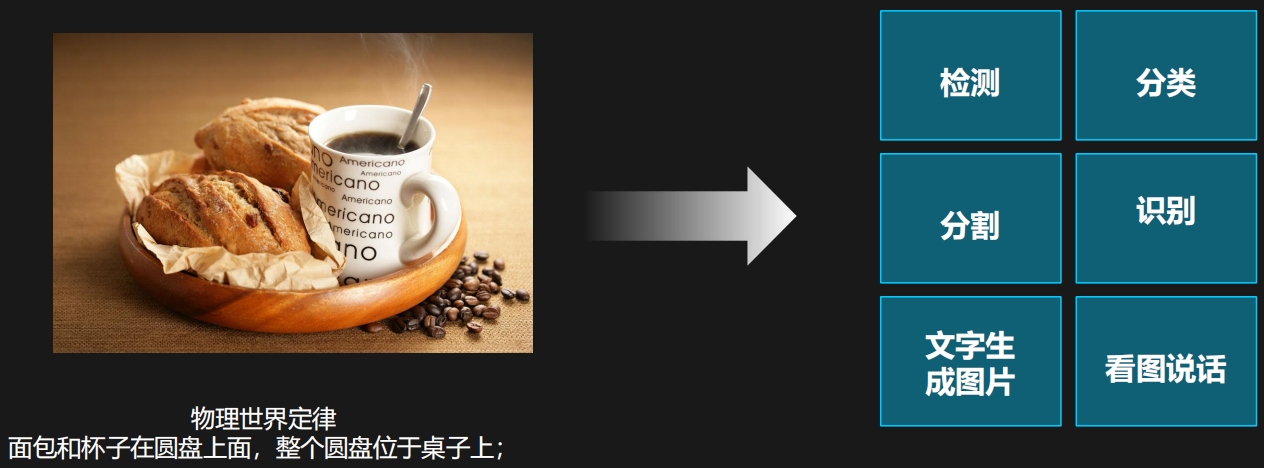

视觉大模型:预测4D空间中的物质

视觉大模型:预测4D空间中的物质

人工智能不断演进,大模型统一了语言与视觉的表征空间

人工智能不断演进,大模型统一了语言与视觉的表征空间

AI 1.0演进到2.0,源于理论、基座、能力的颠覆

AI 1.0演进到2.0,源于理论、基座、能力的颠覆

依图天问多模态大模型逻辑架构图

依图天问多模态大模型逻辑架构图

依图天问多模态大模型让视频情境式理解:会思考、可对话、能进化

依图天问多模态大模型让视频情境式理解:会思考、可对话、能进化

会思考,机器看视频,想法即算法

会思考,机器看视频,想法即算法

大模式时代算法生产方式的变革:业务需要、即刻产生算法,随需而智

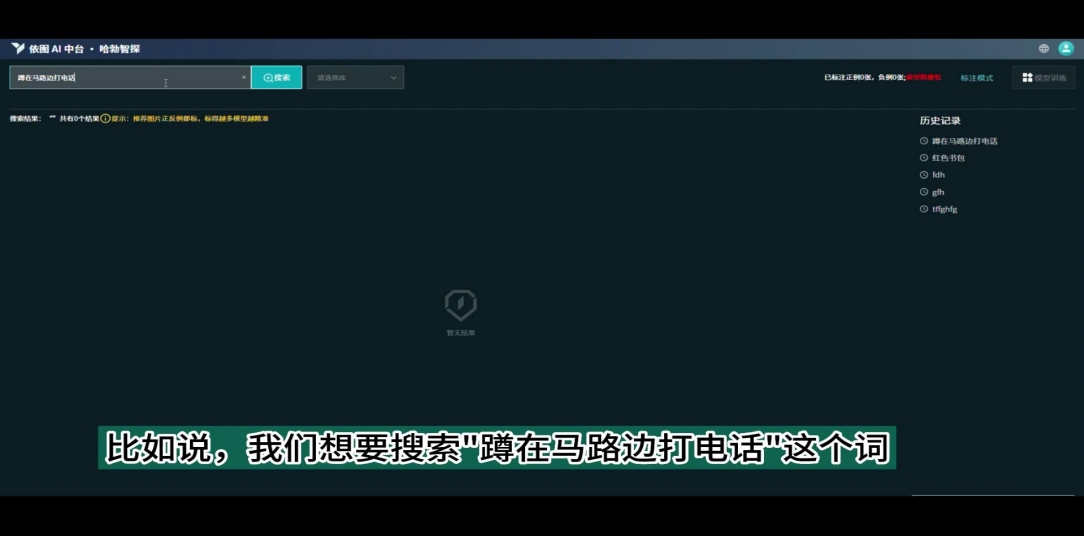

可对话,语义搜万物,语音调视频

可对话,语义搜万物,语音调视频

大模式时代交互体验的变革:越简单,越广泛 Less is More

能进化,边用边训练、越用越聪明

能进化,边用边训练、越用越聪明

大模型时代交付方式的变革:由“现场-实验室-现场”的循环到现场的业务自闭环

核心优势一:依图天问大模型,最懂视频业务的多模态大模型

核心优势一:依图天问大模型,最懂视频业务的多模态大模型

核心优势二:两级架构,大小模型结合,提高算力使用效率

核心优势二:两级架构,大小模型结合,提高算力使用效率

核心优势三:大模型海量特征检索,自研向量数据库支撑高并发比对秒级响应

核心优势三:大模型海量特征检索,自研向量数据库支撑高并发比对秒级响应

张家口市局算法扩容项目

张家口市局算法扩容项目

L1 - L5 全业务闭环,以重点场所、重点区域人群聚集事件的预警、研判、处置为核心赋能实战

南京“城市之眼”项目

南京“城市之眼”项目

构建大模型算法平台,快速实现算法0-1的生产、现场选代训练,赋能城市智治

小样本现场迭代:点击即标注,实现小样本现场分钟级选代,大幅缩短算法上线到满足业务落地的时间,提质增效。

机器看视频城市场景标签化:

基于大模型的情景理解能力,构建城市场景的标签库为应用系统的视频资产管理提供有力支撑。

实战落地58+项目,持续增长

实战落地58+项目,持续增长

目前全国58个局点在POC或者交付中,其中:

• 公共安全38个:主要场景有视频语义搜索、场景大模型训练、大客流管控、重点区域防控、非机动车管控;

• 政府14个:主要场景有城运、应急等政府部门在视频语义搜索、区域管控、长尾算法训练;

• 交管3个:主要场景有交通管控、非机动车管控;

• 内容审核3个:主要场景有赌博、色情、政治敏感等互联网图像内容审核;

• 全国10个省份:上海、浙江、江苏、四川、河北、广东、湖南、山东、陕西、SC;

• 其他:GAB、应急管理部、阿联酋G42和电信政企等,均有POC测试和项目交付;

依图天问大模型产品 - AI中台交付件

依图天问大模型产品 - AI中台交付件

产品推荐

首页

首页